Mon workflow vidéo IA : script Claude, face cam, et Kling 3.0 Motion Control

Temps de lecture : 5 min · Outils : Claude AI + memetete.tarekaghenda.com + Kling 3.0 Motion Control

Je filme ma tête 30 secondes face cam. Je génère un personnage IA cohérent. Et Kling 3.0 Motion Control produit une vidéo où ce personnage reproduit exactement ma performance — mes mouvements, mes expressions, ma façon de parler.

Voici mon workflow complet, étape par étape.

Le workflow en 4 étapes

- Claude AI — écriture du script à prononcer

- Face cam — enregistrement de la performance (30s max)

- memetete.tarekaghenda.com/character — création de l’image cible avec un personnage cohérent

- Kling 3.0 Motion Control — transfert du mouvement face cam → personnage IA

Étape 1 — Écrire le script avec Claude

Le script conditionne toute la suite. Je demande à Claude de l’écrire pour qu’il soit prononcé naturellement face cam en 30 secondes maximum. Pas de phrase complexe, pas de liste — une narration fluide qu’on peut lire en une seule prise.

Le prompt que j’utilise

Rôle : Expert en scripts vidéo courts pour LinkedIn et TikTok.

Tâche : Écris un script de 30 secondes que je vais prononcer

face cam, sans prompteur.

Sujet : [ton sujet]

Contraintes :

- 80 à 100 mots maximum

- Phrases courtes, ton direct, première personne

- Une idée par phrase

- CTA(appel à action) à la fin : [ton CTA]

- Pas de liste, pas de titres — texte continu à l'oral

Format : uniquement le texte du script, prêt à prononcer.Pourquoi 30 secondes ? Kling 3.0 Motion Control accepte des vidéos de référence jusqu’à 30 secondes en mode « video orientation ». C’est la durée optimale pour capturer une performance complète tout en maintenant la cohérence de l’animation. Mais vous pouvez générer plusieurs vidéos avec la meme image de référence et les juxtaposer ensuite dans imovie ou autre.

Étape 2 — Filmer la vidéo de référence

Vous lisez votre script face caméra. Kling va extraire de cette vidéo toute la cinétique de votre performance — mouvements de tête, expressions du visage, gestes — et les transférer sur le personnage cible.

Ce qui compte pour la qualité du transfert

- Cadrage : plan buste, épaules visibles. Kling a besoin de la partie haute du torse pour stabiliser l’animation.

- Fond : uni ou neutre. Un fond chargé peut parasiter l’extraction de mouvement.

- Lumière : frontale, pas de contre-jour. L’IA doit distinguer clairement les contours du visage.

- Vitesse : mouvements mesurés. Les gestes fluides sont mieux transférés que les gestes saccadés.

- Durée : entre 3 et 30 secondes. En dessous de 3s, Kling refuse la vidéo.

La voix de votre face cam n’est pas transférée sur le personnage. Kling extrait uniquement le mouvement visuel. L’audio peut être conservé dans le rendu final ou remplacé par une voix séparée.

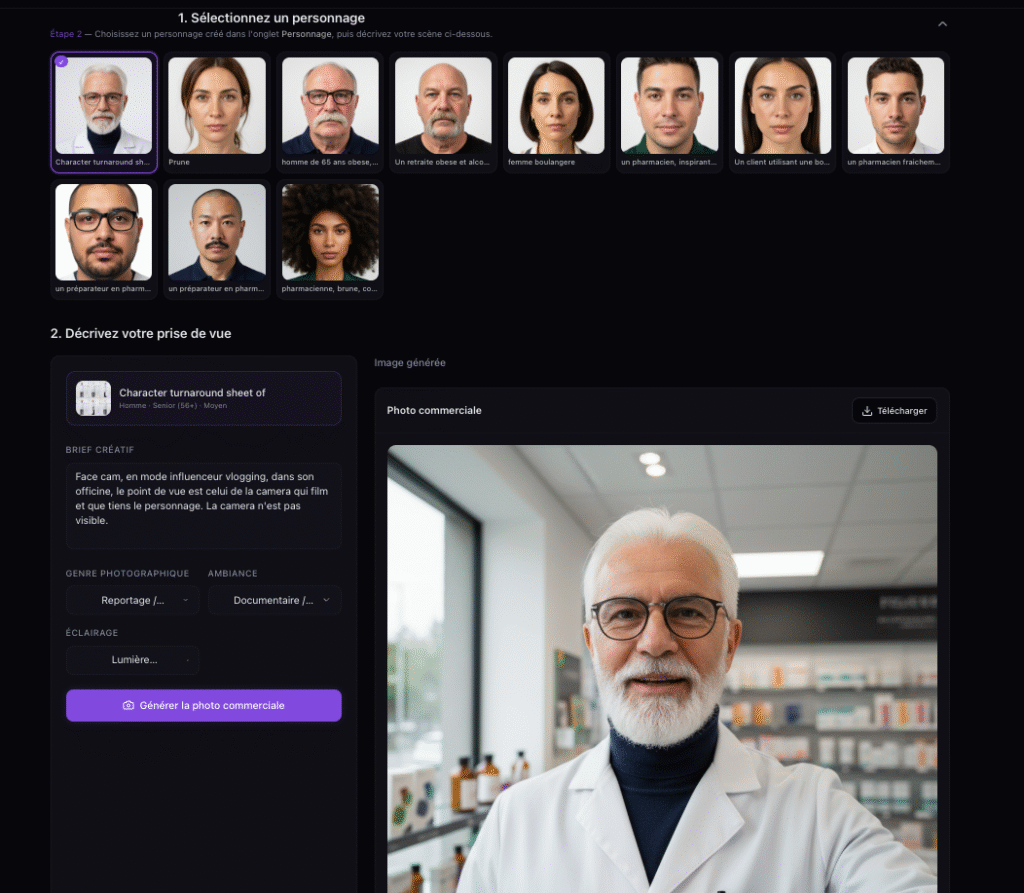

Étape 3 — Préparer l’image cible avec memetete.tarekaghenda.com

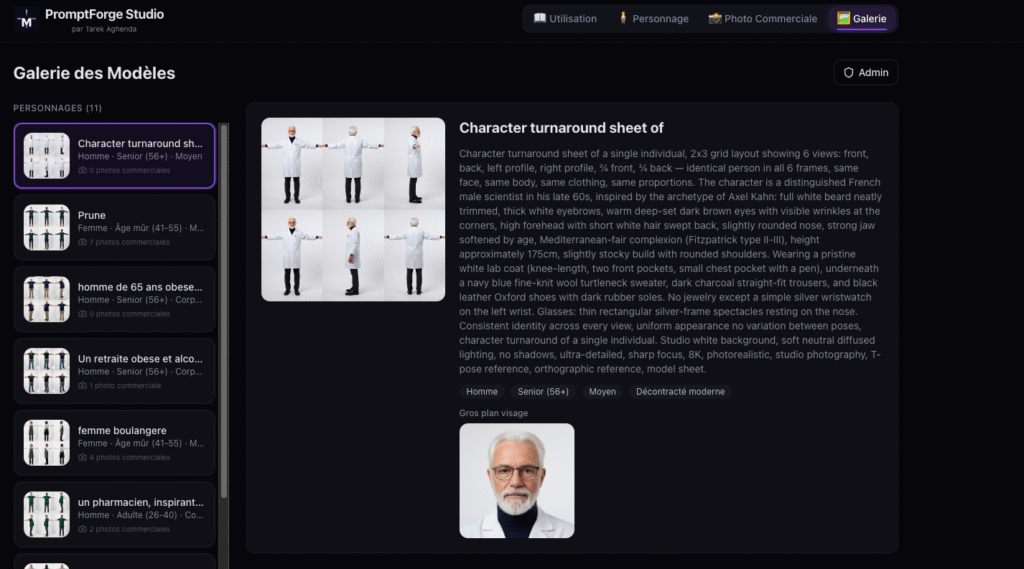

C’est l’étape qui garantit la cohérence visuelle du personnage. Sur memetete.tarekaghenda.com, vous avez deux options : utiliser un personnage déjà existant dans les galeries publiques, ou en créer un nouveau.

Option A — Utiliser un personnage existant depuis les galeries

Les galeries de memetete.tarekaghenda.com sont publiques et accessibles à tous. Elles contiennent des personnages déjà construits — T-pose + série de photos cohérentes — que vous pouvez utiliser directement comme image cible pour Kling, sans passer par l’étape de création.

Vous pouvez aussi utiliser Gemini/Nano Banana, mais memetete vous donnera plus de cohérence sur le long terme (même visage à chaque génération).

- Parcourir les galeries sur memetete.tarekaghenda.com

- Choisir un personnage dont le cadrage correspond à votre face cam — buste visible, orientation similaire

- Télécharger la photo sélectionnée

Option B — Créer votre propre personnage

Si vous voulez un personnage sur-mesure — un avatar branded, un pharmacien avec une tenue spécifique, une version stylisée de vous-même — rendez-vous sur memetete.tarekaghenda.com/character.

Le principe : on commence par une T-pose, qui sert de fiche d’identité du personnage. Elle fixe tous ses attributs visuels — visage, proportions, vêtements, couleurs. L’outil s’en sert ensuite comme référence pour générer des photos cohérentes du même personnage dans n’importe quel contexte.

- Décrire le personnage — genre, âge, apparence physique, tenue. Plus la description est précise, plus le personnage sera stable d’une image à l’autre.

- Générer la T-pose — l’outil produit une fiche en 6 vues (face, dos, profils, trois-quarts). C’est l’ancre identitaire du personnage.

- Générer les photos — à partir de la T-pose, l’outil génère des photos du même personnage dans le contexte de votre choix : bureau, pharmacie, extérieur, studio…

- Sélectionner l’image cible — choisir la photo la mieux cadrée pour Kling.

Critères pour choisir la bonne image cible (options A et B)

- Le personnage est cadré en buste ou en pied, dans une orientation similaire à votre face cam

- Le fond est relativement simple — pas obligatoire, mais facilite le rendu Kling

- Un seul personnage dans l’image

- PNG ou JPG, résolution minimum 512×512 px

Avantage clé : le personnage peut être n’importe quel avatar — un pharmacien, un personnage branded, une version stylisée de vous-même. Vos droits à l’image restent intacts car le visage du résultat final n’est pas le vôtre.

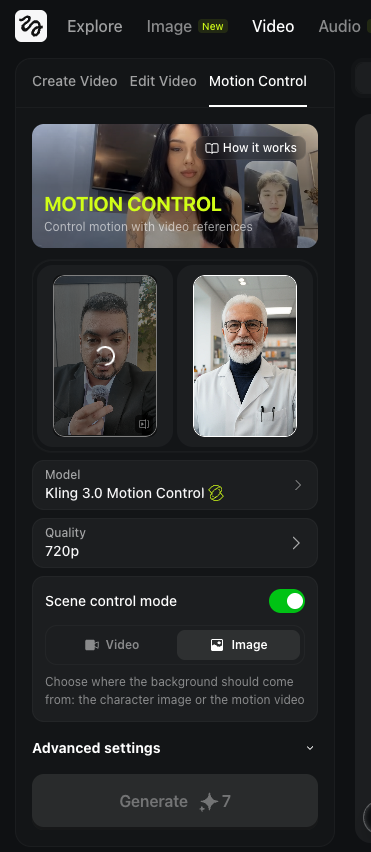

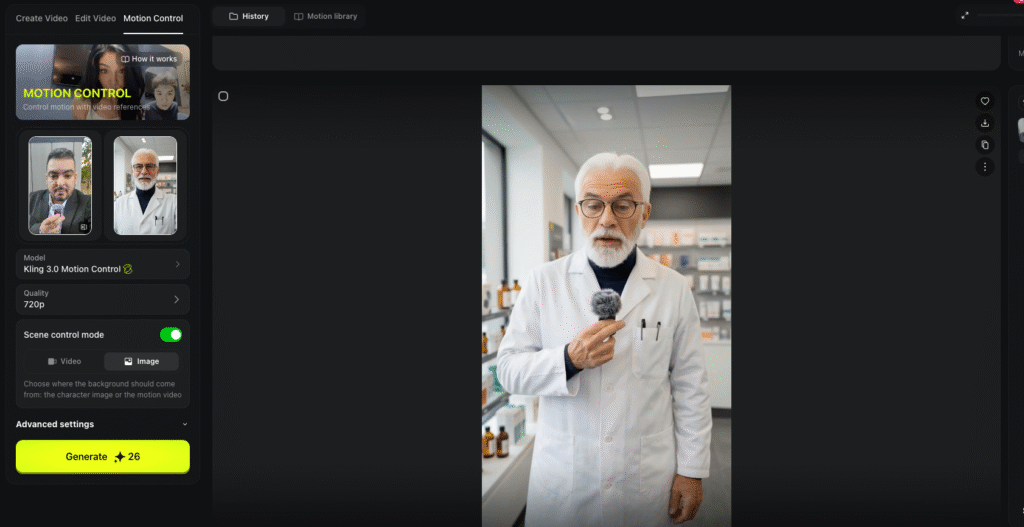

Étape 4 — Générer avec Kling 3.0 Motion Control via ElevenLabs

On travaille directement sur https://higgsfield.ai/create/motion-control. Higgsfield intègre Kling 3.0 comme moteur de génération — vous bénéficiez de la même qualité Motion Control, avec en plus la possibilité d’ajouter voix, musique et sous-titres dans le même outil.

Dans l’interface, sélectionnez le modèle Kling et le mode Motion Control. Vous uploadez deux éléments : l’image cible depuis memetete (l’apparence) et la vidéo face cam (le mouvement). Kling extrait votre performance trame par trame et l’applique sur le personnage.

Les paramètres importants

| Paramètre | Ce qu’il fait | Ma recommandation |

|---|---|---|

| Character orientation | Image = suit la pose de l’image cible (max 10s). Video = suit la perspective de la vidéo face cam (max 30s). | Video — pour un transfert complet de la performance |

| Quality | Standard = 720p. Pro = 1080p. | Standard pour tester, Pro pour la version finale |

| Scene Control Mode | Conserver l’arriere plan de l’image ou de la vidéo de référence | Utiliser l’image comme référence pour le fond. La vidéo si vous souhaitez utiliser votre officine. |

| Prompt texte | Contrôle l’arrière-plan et l’atmosphère sans modifier le mouvement | Ex : « office background, soft warm lighting, professional » |

Ordre de génération recommandé

- Premier test en Standard — vérifier la fluidité du transfert et l’absence d’artefacts.

- Si le résultat est satisfaisant, relancer en Pro pour le rendu final 1080p.

- Si le mouvement est incohérent, raccourcir la vidéo de référence et vérifier l’éclairage.

Points de vigilance : les gestes trop rapides dégradent la précision du transfert. Les mains proches du visage peuvent créer des artefacts. Si l’image cible et la vidéo ont des proportions très différentes (ex. image en pied, vidéo en buste), le résultat risque d’être incohérent.

Récapitulatif — checklist avant de générer

- Script Claude validé : 80–100 mots, phrases courtes, ton oral

- Vidéo face cam : 3–30s, fond neutre, lumière frontale, mouvements fluides

- Image cible : personnage existant depuis les galeries publiques ou nouveau personnage créé sur memetete.tarekaghenda.com/character

- Image cible : buste ou plein corps, sujet unique, PNG/JPG > 512px

- Sur ElevenLabs Image & Video : sélectionner le modèle Kling, mode Motion Control

- Orientation « Video » sélectionnée pour aller jusqu’à 30 secondes

- Premier test en Standard avant de passer en Pro

- Prompt texte ajouté pour l’arrière-plan et l’atmosphère

Les outils

- Claude AI — écriture du script

- memetete.tarekaghenda.com — galeries publiques de personnages existants

- memetete.tarekaghenda.com/character — création d’un nouveau personnage de référence

- ElevenLabs Image & Video — moteur Kling 3.0 Motion Control